プライム・ストラテジー株式会社 執行役員兼マーケティング部長の松隈です。

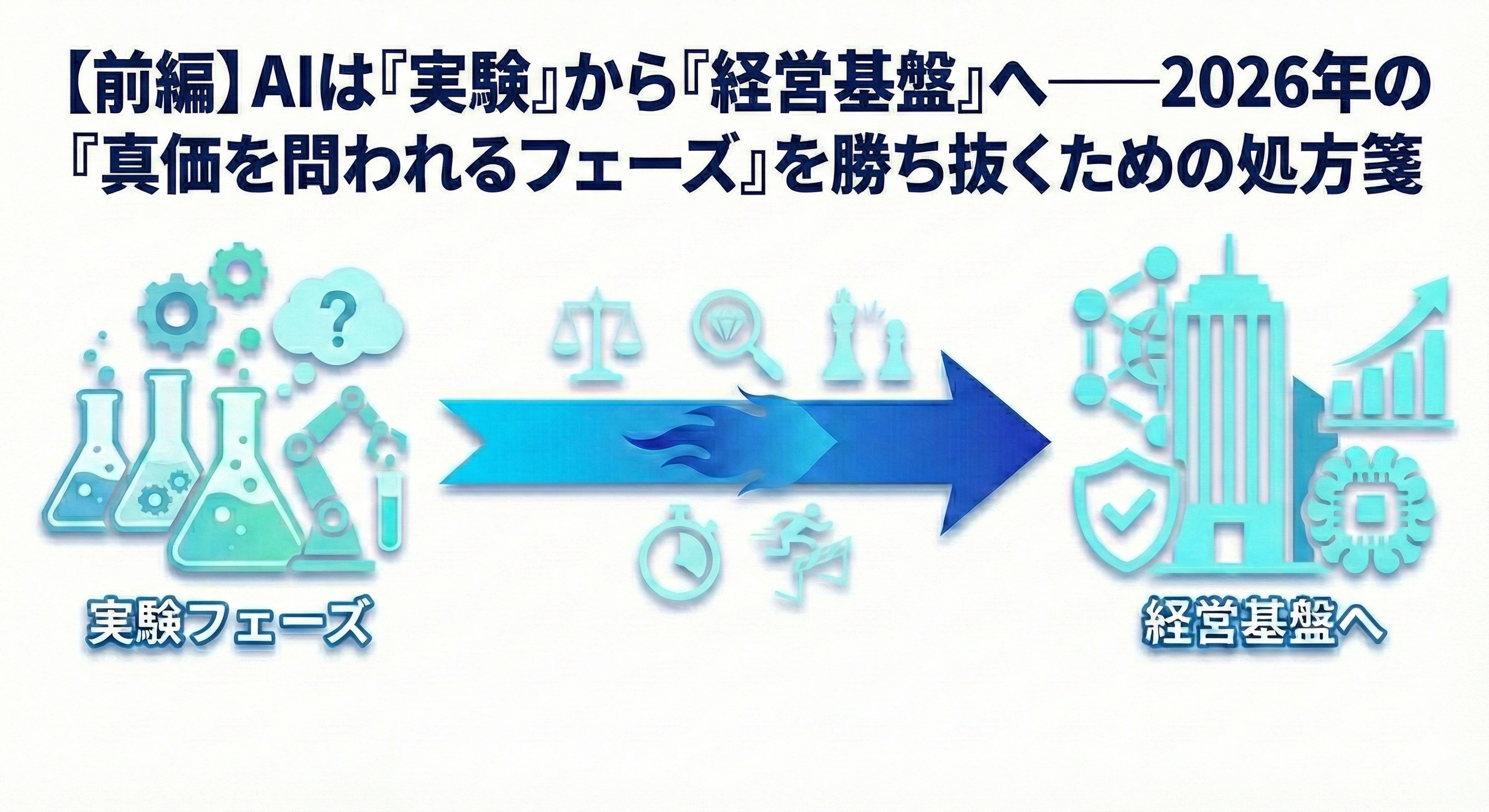

2026年現在、生成AIは「期待のフェーズ」から「真価を問われるフェーズ」へと完全に移行しました。

多くの企業がAIチャットボットの導入を終えた一方で、経営現場では「投資対効果(ROI)の不透明さ」や「スケールに伴うコスト増」というシビアな現実に直面しています。加えて、ツールはあっても「現場での利活用が進まない」という定着化の壁、あるいは導入以前の段階で「経営層や社員の理解が得られず足踏みしている」といった組織的な壁も浮き彫りになっています。

本稿では、AI普及を阻むこれらの「壁」を明確に定義した上で、私たちが開発した汎用RAGサーバーソフトウェア「MAGATAMA Stack(マガタマ・スタック)(*)」が、いかにしてビジネスとテクノロジーの橋渡しを行い、これらの課題を打破するのかを前後編に分けて解説します。

GMOプライム・ストラテジー株式会社 執行役員 兼 マーケティング部長

松隈 基至

プロダクト/サービスのマーケティング全般を担当。前職のSIerではハードウェアエンジニアからキャリアをスタートし、システムエンジニア、広報、商品/サービス企画、マーケティングなど幅広く経験。

(*)MAGATAMA Stackは2026年1月現在、パイロットリリース中。2026年5月にプロトリリースを予定しています。

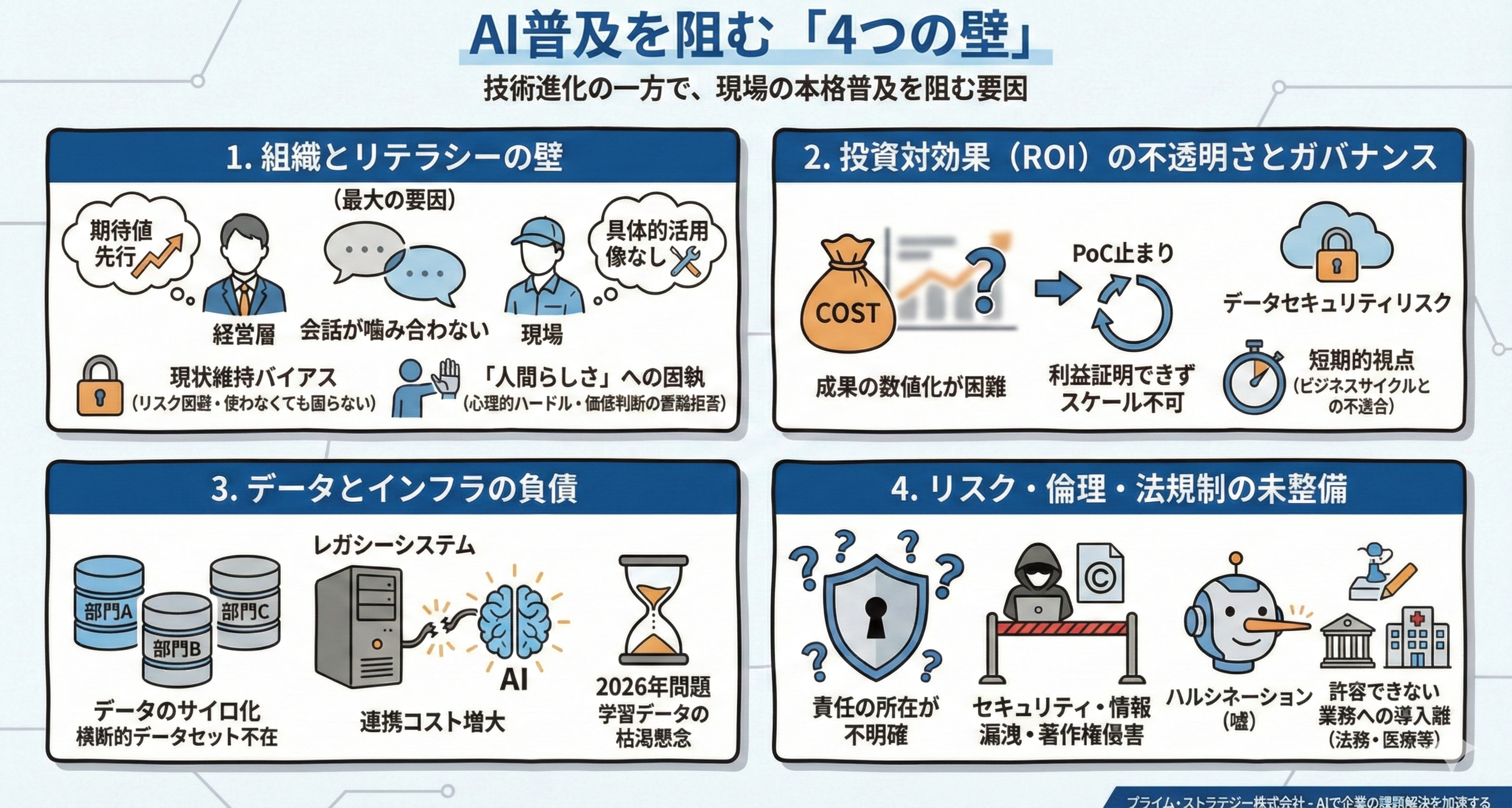

AI普及を阻む「4つの壁」

2025年、AIテクノロジーは劇的な進化を遂げました。特に私たちが目の当たりにしたGPT-5やGemini 3の飛躍は、世界を震撼させるほどのパラダイムシフトでしたが、企業の現場においては、依然として以下の「4つの壁」が本格普及を阻んでいます。

- 組織とリテラシーの壁

- 投資対効果(ROI)の不透明さ

- データとインフラの負債

- リスク・倫理・法規制の未整備

1. 組織とリテラシーの壁

AI導入が進まない最大の要因は、技術の未熟さではなく、それを受け入れる「人間」と「組織」の準備不足にあります。具体的には、以下の3つに集約されるでしょう。

(1)リテラシーの格差と「共通言語」の不在

経営層がAIを「万能な魔法の杖(何でもできる箱)」と捉え、短期間での劇的な成果を期待する一方で、現場はそれを「習得難易度の高い複雑なツール」と見なしています。その結果、現場では導入に伴う心理的・時間的コストへの懸念が先行する傾向にあります。

- 経営層: 戦略的視点や期待値が先行し、実務への具体的な落とし込みや、AI特有の「不確実性」に対する理解が不足している。

- 現場: ツール操作や目先の作業改善に意識が終始し、ビジネス全体を最適化する視点が欠如している。

さらに深刻なのは、経営層がAI導入を単なる「ITツールの購入」と誤認し、変革に必要なプロセスへの理解が得られないことです。 AIを真に機能させるために不可欠な「データの整備」「業務フローの再設計」「社員のリテラシー教育」といった中長期的な投資を軽視し、短絡的なROI(投資対効果)のみを求める姿勢が、現場の疲弊と形骸化を招いています。

これらの視点のズレは、議論の土台となる「共通言語」の不在を招きます。結果として、AI導入の是非を論じる以前に、組織内に深刻なコミュニケーションの分断という壁を作り出しています。

一方で、国内でも経営層自らがAIを日常的に使いこなし、その可能性と限界を正しく理解した上で、トップダウンで活用を強力に推進している企業も現れ始めています。こうした「AIネイティブな組織文化」を形成できた企業と、表面的な導入に留まる企業の間には、数年単位で生産性および競争力において圧倒的な差が生まれることは避けられないでしょう。

(2)変化への抵抗(現状維持バイアスと心理的不安)

AI導入において、単なる「失業への恐怖」以上に深刻なのは、以下のような深層心理におけるリスク回避メカニズムです。特に「プライドと不安」がもたらす心理的抵抗は、組織変革の見えないブレーキとなっています。

・「頑張り」のデフレ化と評価軸の崩壊

長年「時間をかけて丁寧に作業すること」を美徳としてきた組織では、AIによる効率化が評価の空白を生みます。

- 課題: 3日間のリサーチが5分で完了するようになったとき、残りの時間をどう使うべきか、その人の存在意義をどこに求めるべきかの指針がありません。

- 帰結: 自身の貢献が過小評価されることへの防衛本能から、AIの導入を無意識に遠ざけてしまいます。

・責任の非対称性による心理的安全性の欠如

「成功すればAIの手柄、失敗すれば人間の責任」という不均衡な構造が、現場を保守的にさせます。

- 課題: AIの判断を仰ぐことが、個人にとって「リスクは負うがリターンはない」という不合理な選択肢になっています。

- 帰結: 責任の所在が曖昧なままでは、現場がAIを主体的に活用するインセンティブは働きません。

・スキルのコモディティ化と「自尊心の危機」

長年培った「経験、勘、調整力」がAIに代替されることは、単なる業務の置き換えではなく、プロフェッショナルとしての自尊心の喪失に直結します。

- 課題: 「自分にしかできない」という希少性が失われることへの不安が、「使えない」のではなく「(立場を守るために)使いたくない」という拒絶反応を引き起こします。

(3) 「人間らしさ」への固執と日本特有の価値観

日本では「人が手を動かすこと」に価値を置く文化が根強くあります。「人間が関与していること」を価値とする文化は、サービス業や製造業において日本の強みでしたが、AI時代にはそれが足かせになる局面があります。しかし、AI時代に求められるのは「人間が作業すること」ではなく「人間が価値判断に関与すること」です。

- 100点主義の弊害: AIは確率的に答えを出すため、どうしても数%の誤りが含まれます。「人間なら間違えない(はず)」という過度な期待や、一点のミスも許さない文化が、AIのプロトタイプ運用を阻害します。

- プロセスの神聖化: 「真心」や「手作り」を尊ぶあまり、AIによる効率化を「手抜き」や「不誠実」と捉える心理的バイアスが、特に顧客接点において強く働きます。

2. 投資対効果(ROI)の不透明さ

AI導入には多額のコストがかかる一方で、その成果が数値化しにくいという問題があります。

- PoC(概念実証)止まり: 実験的な導入は進むものの、全社的なスケールアップに必要なコスト(インフラ、ライセンス、人件費)に見合う利益が証明できない。

- 短期的視点: AIは学習と改善に時間が必要ですが、四半期ごとの成果を求めるビジネスサイクルと適合しにくい。

3. データとインフラの負債

AIの性能は「データの質」に依存しますが、多くの組織ではその土台が崩れています。

- データのサイロ化: 部門ごとにデータが分断されており、AIが学習できる「横断的なデータセット」が存在しない。

- レガシーシステムとの不適合: 数十年使い続けている基幹システムと最新のAIツールを連携させるためのコストが膨大。

- 2026年問題(学習データの枯渇): インターネット上の高品質な公開データが使い尽くされ、AIの進化が鈍化するという懸念。

4. リスク・倫理・法規制の未整備

「何かあった時の責任」が明確でないことが、企業の腰を重くさせています。

- セキュリティとプライバシー: 機密情報の漏洩リスクや、著作権侵害への懸念により、パブリッククラウドに機密データを送ること自体がリスクとなるため、AI活用が「当たり障りのない一般業務」に限定されてしまう。

- ハルシネーション(嘘): AIがもっともらしい嘘をつくリスクを許容できない業務(法務、医療、金融など)への導入難易度の高さ。

前編のまとめ 技術的な課題よりも、組織文化やコスト構造、データ基盤といった「経営課題」こそがAI活用の本丸です。後編では、「MAGATAMA Stack」がこれらの壁をどのように打破するのか具体的な解決策について詳述します。

執筆者/松隈 基至 GMOプライム・ストラテジー株式会社 執行役員 兼 マーケティング部長

福岡県生まれ。2025年11月にプライム・ストラテジーにジョインし、同社プロダクト/サービスのマーケティング全般を担当。

前職のSIerではハードウェアエンジニアからキャリアをスタートし、システムエンジニア、広報、商品/サービス企画、マーケティングなど幅広く経験。

趣味は音楽、釣り、ロードバイク、サバゲー、アクアリウムなど。